Textanalyse und Textgenerierung/syntaktische Struktur

Einführung

[Bearbeiten]Der Einsatz von generativer KI hat mit der Verfügbarkeit der Technologie an gesellschaftlicher Bedeutung und Sichtbarkeit gewonnen. Ein Verständnis von generativen Grammatiken ist ein Baustein im Umgang mit mathematischen Modellen und Texterzeugung. Diese Lerneinheit führt in das Themengebiet ein.

Regelsystem

[Bearbeiten]Zunächst wird dabei in das Konzept von Regelsystemen zur Beschreibung von syntaktischen Strukturen eingeführt und die Kontextsentivität bzw. Kontextabhängigkeit von Regeln behandelt.

Wahrscheinlichkeitskeitsverteilung auf Ersetzungsoptionen

[Bearbeiten]Danach werden Wahrscheinlichkeitsverteilungen für Ersetzungsoptionen behandelt, mit denen die Wahrscheinlichkeit der Anwendung einer Regeloption definiert wird.

Chomskys - generative Grammatik

[Bearbeiten]Spricht man von generativer Grammatik, ist zumeist die von Chomsky entwickelte Theorie gemeint, die zwar mit der Standardtheorie auch semantische Komponenten einbezieht (siehe auch Interpretative Semantik), jedoch die syntaktische Komponente in das Zentrum stellte.

Chomsky und Compilerbau

[Bearbeiten]Wenn Quellcode (z.B. C++) in einen auf einer Maschine (Computer) ausführbaren Code übersetzt werden soll, benötigt man einen Compiler der diese Übersetzung vornimmt. Im Compilerbau muss man die syntaktisch Korrektheit des Quellcodes überprüfen. Diese Überprüfung erfolgt unter Verwendung einer Grammatik, die die Sprachstruktur beschreibt.

Phonetische Repräsentation

[Bearbeiten]Das Gesamtmodell enthält außerdem eine phonologische Komponente, die aus den syntaktischen Strukturen und den lexikalischen Wortformen durch sukzessive Anwendung von Regeln eine phonetische Repräsentation erzeugt. Das grundlegende Werk dazu ist The Sound Pattern of English (1968) von Chomsky und Morris Halle.

Entwicklungsstadien der generativen Grammatik Chomskys

[Bearbeiten]Die generative Grammatik hat bei Chomsky mehrere Entwicklungsstadien durchlaufen:[1][2]

- 1955–1964: frühe Transformationsgrammatik (Chomskys Syntactic Structures)

- 1965–1970: Standardtheorie (ST)

- 1967–1980: Erweiterte Standardtheorie (EST) bzw. Revidierte Erweiterte Standardtheorie (REST) (Konzept der Modularität)

- seit 1980: Government and Binding Theory (GB)

- 1990er Jahre: „Minimalistisches Programm“

Bezug zur Chomsky-Hierarchie

[Bearbeiten]

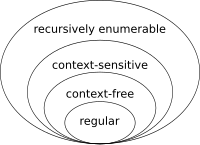

Generative Grammatiken können mit Hilfe der Chomsky-Hierarchie verglichen und beschrieben werden, die von Noam Chomsky in den 50er Jahren entworfen wurde. Diese ordnet eine Reihe von verschiedenen Typen formaler Grammatiken nach ansteigender expressiver Kraft.

Terminal- und Nichtterminal-Symbole

[Bearbeiten]Sie unterscheiden sich durch ihre Symbol- (Terminal- und Nichtterminal-Symbole) und Produktionsregelsysteme und müssen verschiedenen genau festgelegten Überprüfungsmethoden (z. B. durch Turingmaschinen) genügen.

Beispiel - Natürliche Zahl

[Bearbeiten]In dem folgenden Beispiel ist eine natürliche Zahl als grammatikalische Regel beschrieben.

- <natuerlicheZahl> := <Ziffer0> || <Ziffer1><Ziffernsequenz>

- <Ziffernsequenz> := <Ziffer0>|| <Ziffer0><Ziffernsequenz>

- <Ziffer1> := "1" || "2" || "3" || "4" || "5" || "6" || "7" || "8" || "9"

- <Ziffer0> := "0" || <Ziffer1>

Terminalsymbole sind "0" bis "9" und Nichtterminalsymbole sind <natuerlicheZahl> und <Ziffer1>, die man als Variablen auffasst, die durch Anwendung von Regeln in eine Zeichenkette von terminalen Symbolen ersetzt werden kann.

Bezeichnungen

[Bearbeiten]- ":=" definiert eine Ersetzungsregel der Grammatik, wobei auf der linken Seite ein nichtterminales Symbol (Variable) steht, die durch die rechte Seite ersetzt werden kann.

- "||" bezeichnet ein logisches "ODER", wobei dieses Symbol Ableitungsalternativen kennzeichnet.

- Zeichen bzw. Zeichenketten in Anführungszeichen bezeichnem terminale Symbole

- bei nichtterminalen Symbolen wird der Variablenbezeichner durch "<" und ">" eingefasst.

Aufgabe

[Bearbeiten]Überprüfen Sie mit der Grammatik, ob die folgenden Zahlen syntaktisch korrekt geschrieben wurden:

- 5

- 173

- 012

Endlicher Automat für natürliche Zahlen

[Bearbeiten]Grammatiktypen

[Bearbeiten]Typ 0 (uneingeschränkt formale Grammatiken) schließt alle formalen Grammatiken ein.

Reguläre Grammatiken

[Bearbeiten]Die einfachsten Typen sind die regulären Grammatiken (Typ 3). Nach Chomsky sind sie nicht zur Abbildung natürlicher Sprachen geeignet, da sie keine Sätze in einer hierarchischen Anordnung (Hypotaxe) modellieren können, welche seiner Meinung nach für das menschliche Kommunikationssystem typisch ist.

Kontexfreie Grammatiken

[Bearbeiten]Die obige einfache Grammatik zur Beschreibung einer natürlichen Zahl ist vom Typ 1 und damit kontextfreien Grammatik. Kontextfrei meint dabei, dass die Anwendung von einer Ersetzungsregel nicht von dem rechten und linken Kontext im Text abhängt. Man darf also das Nichtterminalsymbole sind <natuerlicheZahl> unabhängig vom Kontext

- entweder durch <Ziffer0>

- oder die Verkettung von <Ziffer1><Ziffernsequenz>

kontextsensitiven Grammatiken

[Bearbeiten]Diesen Anforderungen werden dagegen die auf einer höheren Komplexitätsstufe stehenden kontextsensitiven Grammatiken gestellt, denn dort hängen die Ersetzungsregel eines nichtterminalen Symbols von einem Rechtskontext und Linkskontext . Je nach Kontext wird dann eine andere Ersetzungregel angewendet.

Ableitung von syntaktisch korrekten Wörtern der Grammatik

[Bearbeiten]Ausgehend von einem Startsymbol (oben <natuerlicheZahl>) versucht man durch Anwendung von Ableitungsregeln bzw. Ersetzungsregel nun eine Kette von terminale Zeichen zu erzeugen. Diese mit der Grammatik gebildeten Wörter sind die syntaktisch korrekten Wörter eine Sprache. Die Zeichenkette "013" besteht zwar aus einer Zeichenfolge aus Ziffern, aber nach der oben angegeben Grammatik wäre das keine zulässige natürliche Zahl aus der Grammatik.

Aufgabe

[Bearbeiten]Berechnen Sie alle kombinatorischen möglichen natürlichen Zahlen , die als zulässige Wörter der obigen Grammatik verwendet werden können. Welche kom binatorischen Modelle werden Sie dabei an?

Baumstruktur eine Ableitung

[Bearbeiten]Chomskys „Phrasenstrukturgrammatik“, in der die Ableitung eines Satzes als Baumstruktur dargestellt wird. Dieser Ansicht zufolge sind Sätze nicht nur Ketten von Wörtern, sondern strukturierte Objekte mit unter- und übergeordneten Einheiten, die in Bäumen mit Ästen, die durch Knotenpunkte verbunden sind, dargestellt werden können. Allgemeiner werden Sprachen Grammatiken auf Satzstrukturen angewendet, wie das folgende Beispiel zeigt.

Beispiel für ein Baum

[Bearbeiten]Das Baummodell wird in diesem Beispiel dargestellt, in dem der S-Knoten einen Satz dominiert. D repräsentiert einen Determinierer, N ein Nomen, V ein Verb, NP eine Nominalphrase und VP eine Verbalphrase:[3]

Nichterminale Symbole 1

[Bearbeiten]- S – Satz

- D – Determinierer

- N – Nomen

- V – Verb

- NP – Nominalphrase

- VP – Verbalphrase

Nichterminale Symbole 2

[Bearbeiten]- Aux – Hilfsverben

- A – Adjektive

- Adv – Adverbien

- P – Präpositionen

- Pr – Pronomen

- C – Komplementierer

Generierter Satz

[Bearbeiten]Der generierte Satz lautet „Der Hund fraß den Knochen“, der wiederum aus eine Kette von terminalen Symbolen besteht. Ein solches Baumdiagramm wird auch als Phrasenstrukturmodell bezeichnet. Derartige Baumdiagramme lassen sich aufgrund der zugrundegelegten Regeln automatisch generieren (siehe Weblinks).

Bäume als geklammerter Text

[Bearbeiten]Der Baum kann auch als geklammerter Text dargestellt werden, auch wenn dieser schwieriger zu lesen ist:

[S [NP [D Der ] [N Hund ] ] [VP [V fraß ] [NP [D den ] [N Knochen ] ] ] ]

Ersetzungsregeln

[Bearbeiten]Die Erzeugungsregeln für diese Struktur sind von der Form "A → B C", also etwa "S → NP VP". Chomsky gelangte zu der Erkenntnis, dass auch die Phrasenstruktur nicht ausreicht, um natürliche Sprachen zu beschreiben. Um das zu beheben, formulierte er das komplexere System der Transformationsgrammatik. Transformationsregeln haben die Fähigkeit, aus einer Struktur wie der oben dargestellten eine andere Struktur abzuleiten. Sie können z. B. einen Teil der Struktur an einen anderen Platz umsetzen (Bewegungsregeln).

Ersetzungsregeln für die mathematische Ableitung

[Bearbeiten]Ableitung wird in diesem Kontext für den Begriff aus der Analysis verwendet und sollte daher nicht mit dem Ableitungsbegriff in einer Grammatik durch die Anwendung von Regeln

Wahrscheinlichkeitsverteilung und Regeln

[Bearbeiten]In den obigen Beispielen wurden Regeln angegeben, wobei die Ersetzungsalternativen durch ein ODER-Zeichen "||" angegeben wurden. Diese Entscheidungsalternativen können nun mit Wahrscheinlichkeiten belegt werden.

Kontextabhängigkeit

[Bearbeiten]Wir betrachten nun ein einfaches Sprachbeispiel, was die Kontextabhängigkeit in einem Regelsystem mit einer ODER-Verknüpfung deutlich machen soll.

Beschreibung des Beispiels

[Bearbeiten]Der Wort "Feuer" führt in dem folgenden Beispiel je nach Situation zu einer anderen Aktion/Handlung:

- "Feuer" mit einer "Zigarette" in der Hand führt zu einer Aktion "Feuerzeug", mit dem man die Zigarette anzündet.

- "Feuer" mit einem "brennenden Haus" im Hintergrund für zu einer Aktion "Feuerwehr", um durch einen Anruf den Brand löschen zu können.

Ausgangssituation als Regelsystem

[Bearbeiten]Die Ausgangssituation ist, dass eine Person "Feuer" sagt. Diese Ausdruck sei durch das nichtterminale Symbol < FEUER > repräsentatiert, das von einem weiteren nichtterminale Symbol < AKTION > gefolgt wird. Vor dem nichtterminale Symbol < FEUER > steht ein weiteres nichtterminale Symbol < SITUATION >, was den Linkskontext von < FEUER > beschreibt.

Kontext und Bezug zum nichtterminalen Symbol

[Bearbeiten]Der Linkskontext (und natürlich auch der Rechtskontext) wird immer in Bezug eine spezielles nichtterminales Symbol interpretiert. Der Linkskontext vom nichtterminalen Symbol < AKTION > besteht in diesem Fall aus < S >< FEUER > und der Rechtskontext ist leer. Der Rechtskontext von < FEUER > besteht hier aus nur einem Symbol < AKTION >.

Kontextabhängigkeit der Ableitung

[Bearbeiten]Bei kontextsensitiven Grammatiken hängt die Ersetzung durch eine Regel und einer Wahrscheinlichkeitsverteilung auf ODER-Optionen von dem Links- und/oder Rechtskontext ab. Dabei kann ein Teil des gesamten Linkskontext und Rechtskontextes im Regelsystem angegeben werden, der vorhanden muss, um eine bestimmte kontextsensitive Regel anwenden zu können.

Ersetzungsoptionen für LINKSKONTEXT

[Bearbeiten]Für den Ausruf "Feuer" verwenden wir die Ersetzungsoptionen für das nichtterminale Symbol < SITUATION >. Diese sollte zunächst kontextfrei angegeben werden.

< SITUATION > := < FEUERZEUG > || < FEUERWEHR >

Ersetzungsoptionen für die Aktion AKTION

[Bearbeiten]In diesem elementaren Beispiel verwenden wir die Ersetzungsoptionen für das nichtterminale Symbol < AKTION >. Diese sollte zunächst kontextfrei angegeben werden.

< AKTION > := < FEUERZEUG > || < FEUERWEHR >

Aufgabe

[Bearbeiten]Definieren Sie eine kontextsensitive Regel und in Abhängigkeit von dem Linkskontext eine Wahrescheinlichkeitsverteilung (hier Bernoulli-Verteilung).

Bezüge zu anderen Disziplinen

[Bearbeiten]Das Konzept von Grammatiken Beschreibung syntaktischer Struktur von Sprache wird in unterschiedlichen Disziplinen verwendet bzw. basiert auf deren Konzepten::

- Informatik - Anwendung auf Programmiersprachen

- Cartesianische Logik - Regelsystem in Sprachen zu beschreiben

Informatik - Compilerbau

[Bearbeiten]In der Informatik dienen Grammatiken dazu syntaktische Korrektheit von Programmcode über ein Regelsystem zu definieren. Beim Parsen des Programmcodes versucht man den gegeben Programmcode sukzessive durch das Regelsystem auf das nichtterminale Startsymbol der Grammatik zu reduzieren- Ist das möglich, ist das Programm syntaktisch korrekt, falls das nicht möglich ist, enthält das Programm durch Verletzung einer oder mehrerer Regeln einen syntaktischen Fehler.

Cartesianische Logik

[Bearbeiten]Chomsky griff bei seinen Überlegungen auf die Cartesianische Logik (s. Cartesianische Linguistik[4]) zurück.[5] Ziel der generativen Transformationsgrammatik „ist es also, durch ein System von expliziten Regeln das implizite Wissen von Sprache abzubilden und damit eine logisch begründete Theorie über das Denken der Menschen zu schaffen“[6], womit „die aufklärerische Idee logischer Formen“[6] fortgesetzt wird.

Kognitive Psychologie

[Bearbeiten]„Bei Chomsky dient die Analyse der Sprache letztlich dazu, Aufbau und Funktionsweise des menschlichen Gehirns zu erforschen, für ihn wird die Linguistik etwas wie die Teildisziplin der Kognitiven Psychologie“.[7] Kritisiert wird, dass alle Versuche der Sprachpsychologie zeigen sollen, dass die generative Grammatik „ein logisches, kein psychologisches Modell“ ist.[8]

Quellennachweise

[Bearbeiten]- ↑ Michael Dürr, Peter Schoblinski: Deskriptive Linguistik: Grundlagen und Methoden. 3. Auflage. Vandenhoeck und Ruprecht, Göttingen 2006, ISBN 3-525-26518-2, S. 115.

- ↑ Heidrun Pelz: Linguistik. 1996, S. 174 ff. („Erste Version“ – ST – EST – RST – GB, dabei die generative Semantik zwischen ST und EST anführend).

- ↑ Einführung in die Grundlagen der Generativen Grammatik. (PDF) TU Dresden, WS 2003/2004, S. 1–19

- ↑ Noam Chomsky: Cartesianische Linguistik. Ein Kapitel in der Geschichte des Rationalismus. Tübingen 1971. Übersetzung (R. Kruse) von Noam Chomsky: Cartesian linguistics: a chapter in the history of rationalist thought. University Press of America, Lanham, Maryland 1965. Reprint: University Press, Cambridge 2009.

- ↑ Dietrich Homberger: Sachwörterbuch zur Sprachwissenschaft. Reclam, Stuttgart 2000, ISBN 3-15-010471-8 (Strukturalismus).

- ↑ a b Radegundis Stolze: Übersetzungstheorien: eine Einführung. 4. Auflage. Narr, Tübingen 2005, ISBN 3-8233-6197-X, S. 42.

- ↑ Heidrun Pelz: Linguistik. 1996, S. 172.

- ↑ Christoph Schwarze, Dieter Wunderlich (Hrsg.): Handbuch der Lexikologie. Athenäum, Königstein/Ts. 1985, ISBN 3-7610-8331-9, Zur Zerlegbarkeit von Wortbedeutungen, S. 64, 88.

Seiteninformation

[Bearbeiten]Diese Lernresource können Sie als Wiki2Reveal-Foliensatz darstellen.

Wiki2Reveal

[Bearbeiten]Dieser Wiki2Reveal Foliensatz wurde für den Lerneinheit Textanalyse und Textgenerierung' erstellt der Link für die Wiki2Reveal-Folien wurde mit dem Wiki2Reveal-Linkgenerator erstellt.

- Die Seite wurde als Dokumententyp PanDocElectron-SLIDE erstellt.

- Link zur Quelle in Wikiversity: https://de.wikiversity.org/wiki/Textanalyse%20und%20Textgenerierung/syntaktische%20Struktur

- siehe auch weitere Informationen zu Wiki2Reveal und unter Wiki2Reveal-Linkgenerator.

Wikipedia2Wikiversity

[Bearbeiten]Diese Seite wurde auf Basis der folgenden Wikipedia-Quelle erstellt: