Gradientenabstiegsverfahren

Einführung

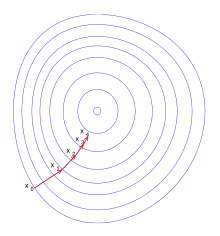

[Bearbeiten]Das Gradientenverfahren, auch Verfahren des steilsten Abstiegs genannt, ist ein Verfahren, das in der Numerik eingesetzt wird, um allgemeine Optimierungsprobleme zu lösen. Dabei geht man (am Beispiel eines Minimierungsproblems) von einem Näherungswert aus. Von diesem schreitet man in Richtung des negativen Gradienten (der die Richtung des steilsten Abstiegs von diesem Näherungswert angibt) fort, bis man keine numerische Verbesserung mehr erzielt.[1]

Animation

[Bearbeiten]

Bemerkung - Animation

[Bearbeiten]In der Animation werden Startpunkte in ein rechteckigen Gitter schachbrettmusterartig in dem Definitionsbereich verteilt. Jede Einzelbewegung dieser Punkte stellt einen Gradientenabstieg dar. Wenn der Gradientenabstieg gegen ein lokale Minimum konvergiert, so muss das nicht das absolute Minimum (z.B. von einer Fehlerfunktion/Kostenfunktion) sein. Wenn man die Startpunkte gitterartig im Definitionsbereich verteilt, findet man ggf. mehrere lokale Minima und wählt dann in einem letzten Optimierungsschritte die Stelle aus, die den geringsten Wert der Zielfunktion (Fehlerfunktion oder Kostenfunktion) besitzt.

Wiki2Reveal-Folien

[Bearbeiten]Diese Seite zum Gradientenabstiegsverfahren ist zugleich ein Wik2Reveal-Foliensatz ![]() .

.

CAS4Wiki - Partielle Ableitung

[Bearbeiten]Diese Lernressource enthält CAS4Wiki-Testlinks zur

- Berechnung von partiellen Ableitung mit folgendem CAS4Wiki-Startlink für partielle Ableitungen

Bemerkung Konvergenz

[Bearbeiten]Das Verfahren konvergiert oftmals sehr langsam, da es sich dem OptimuÏm mit einem starken Zickzack-Kurs nähert. Für die Lösung von symmetrisch positiv definiten linearen Gleichungssystemen bietet das Verfahren der konjugierten Gradienten hier eine immense Verbesserung. Der Gradientenabstieg ist mit dem Bergsteigeralgorithmus (hill climbing) verwandt.

Das Optimierungsproblem

[Bearbeiten]Das Gradientenverfahren ist einsetzbar, wenn es um die Minimierung einer reellwertigen, differenzierbaren Funktion geht; also um das Optimierungsproblem

Hierbei handelt es sich um ein Problem der Optimierung ohne Nebenbedingungen, auch unrestringiertes Optimierungsproblem genannt.

Wesentliche Schritte

[Bearbeiten]- Gradient zeigt in die Richtung der "stärksten" Steigung.

- der negative Gradient zeigt daher in die Richtung, in der die Funktionswerte von fallen.

- Es kann passieren, dass man bei einem Iterationsschritt über das lokale Minimum der Funktion hinwegspringt. Dann würde man die Schrittweite entsprechend verkleinern, um den Funktionswert von weiter zu minimieren und genauer zu approximieren.

Abbruchbedingung

[Bearbeiten]- Abbruchbedingung für das Gradientabstiegsverfahren wäre, wenn wir mit der Iteration eine Stelle gefunden haben an der der Gradient von 0 ist

- .

Allgemein ist der Gradient einer Stelle für den -ten Iterationsschritt wie folgt über die partiellen Ableitungen definiert:

Notation

[Bearbeiten]Es wird die englische Notation für den Dezimalpunkt statt Komma verwendet. Dies wird analog zu Computer-Algebra-Systemen gemacht, damit die Trennung zwischen Komponenten in einem -Tupel auch mit Zahlen möglich ist. ist ein Vektor mit zwei Komponenten. Besitzen die Komponenten des Vektors Nachkommastellen, werden diese mit einem Punkt notiert - z.B.

Beispiel für einen Gradienten

[Bearbeiten]Sei :

Damit können wir den Gradienten an eine bestimmten Stelle im Definitionsbereich berechnen:

CAS4Wiki

[Bearbeiten]Mit CAS4Wiki können Sie die obigen Ableitung berechnen, siehe z.B. partielle Ableitungen

Beispiel - normierter Gradienten

[Bearbeiten]Mit einem vom Nullvektor verschiedenen Gradienten kann man einen normierten "negativen" Gradienten erzeugen:

Das Verfahren

[Bearbeiten]Als Einführung in das Gradientenabstiegsverfahren wird eine vereinfachte Schrittweitenberechung verwendet.

- Das Verfahren bricht ab, wenn der Gradient der Nullvektor ist.

- Ist der Gradient nicht der Nullvektor, wird der negative Gradient zunächst auf die Länge 1 normiert und mit der Schrittweite multipliziert.

- Die Schrittweite wird halbiert, wenn nach dem Iterationsschritt der Funktionwert (z.B. Kosten) nicht abnehmen.

- Eine weitere Abbruchbedingung für die Iteration ist, wenn die Schrittweite eine Genauigkeitsgrenze unterschreitet (d.h. ).

Start der Optimierung

[Bearbeiten]Als Anfangspunkt wird eine Stelle aus dem Definitionsbereich der Funktion ausgewählt, für die man lokale Minima mit dem Gradientenabstiegsverfahren annähern möchte.

Richtung des steilsten Abstiegs

[Bearbeiten]Ausgehend von einem Anfangspunkt bzw. von der aktuelle Stelle für den nächsten Iterationsschritt wird die Richtung des steilsten Abstiegs durch bestimmt, wobei den Gradienten von an der Stelle bezeichnet. Dieser zeigt in die Richtung des "größten Anstiegs". Das negative Vorzeichen vor dem Gradienten sorgt dafür, dass man sich mit den Iterationsschritten in die Richtung des stärksten Abfalls bewegt (z.B. Minimierung der Kostenfunktion/Fehlerfunktion ).

Normierung des Richtungsvektors

[Bearbeiten]Das vereinfachte Interationsverfahren bricht bei der Bedingung ab, wenn . Ansonsten wird der Richtungsvektor für den folgenden Iterationsschritt normiert (dies ist optional, um die Schrittweite im Lernalgorithmus zu normalisieren) :

Iterationsschritt

[Bearbeiten]

Formal notiert man diesen Iterationsschritt wie folgt:

Wenn keine Verbesserung vorliegt, wird die Schrittweite verkleinert (z.B. halbiert).

Festlegung der Schrittweite

[Bearbeiten]Die Schrittweite wird so lange für den nächsten Iterationsschritt verwendet, bis sich die Kostenfunktion mit dem nachfolgende Schritt erhöht. In diesem einführenden Beispiel wird die Schrittweite halbiert. Formal

Alternative Schrittweitenverkleinerung

[Bearbeiten]Die Schrittweitenverkleinerung kann allgemein auch durch einen Faktor mit über

ersetzt werden.

Schrittweitenfestlegung pro Iterationsschritt

[Bearbeiten]Dabei ist die Schrittweite im j-ten Iterationschritt. Diese Schrittweite muss in jedem Schritt des Iterationsverfahrens bestimmt werden. Hierfür gibt es im Allgemeinen unterschiedliche Möglichkeiten, wie die Rückführung der Schrittweitenbestimmung auf ein eindimensionales Optimierungsproblem. Die hier gewählte Schrittweitenoptimierung ist als Einführung in das Thema gewählt worden.

Gradientenabstieg in Tabellenkalkulation

[Bearbeiten]In der folgenden ZIP-Datei von GitHub befindet sich eine LibreOffice-Datei mit einem exemplarischen Gradientenabstieg für die Kostenfunktion:

- .

Die Kostenfunktion hat auf ihrem Definitionsbereich unendlich viele lokale Minima. Das Minimum der Kostenfunktion ist nach Definition -1. In jeder Tabellenzeile wird ein Iterationsschritt durchgeführt und überprüft, ob die Kostenfunktion nach dem Iterationsschritt tatsächlich abnimmt.

Rückführung auf ein eindimensionales Optimierungsproblem

[Bearbeiten]Eine Methode besteht darin, durch die Minimierung der Funktion auf dem (eindimensionalen) "Strahl" zu bestimmen, der ausgehend von in Richtung des negativen Gradienten zeigt. Die eindimensionale zu minimierende Funktion ist wie folgt definiert.

- mit

Man berechnet in diesem Fall das mit so, dass minimal wird. d.h.:

Dies ist ein einfaches, eindimensionales Optimierungsproblem, für das es spezielle Verfahren der Schrittweitenbestimmung gibt.

Schrittweiten und iterierte Schrittweitenverkleinerung

[Bearbeiten]Eine andere Methode besteht darin, von der Minimierung der Funktion abhängig zu machen, d. h. von der Bedingung . Wird mit dem Iterationsschritt der Funktionswert mit einer Startschrittweite nicht vermindert, verkleinert man die Schrittweite z. B. mit mit weiter, bis die Schrittweite ausgehend von in Richtung des negativen Gradienten tatsächlich einen Funktionswert liefert und setzt .

Hat man im Iterationsverfahren eine Stelle mit erreicht, liegt eventuell eine lokale Extremstelle von vor (Überprüfung bzw. Abbruch des Iterationsverfahrens).

Abbruchbedingung

[Bearbeiten]Ein zentrales Kriterium für eine Abbruchbedingung ist, dass ist.

Sattelpunkt/Sattelfläche

[Bearbeiten]Wie in der reellen eindimensionalen Analysis muss sich an dieser Stelle keine lokales Minimum befinden (eindimensional Sattelpunkt, mehrdimensional z.B. Sattelfläche). Wenn für zweimal stetig differenzierbar ist und die Hesse-Matrix an dieser Stelle positiv definit ist, liegt in hinreichendes Kriterium für ein lokales Minimum. Dieses wird ausgegeben und die Iteration abgebrochen.

Schrittweite als Abbruchbedingung

[Bearbeiten]Wird der Algorithmus auf einem Computer ausgeführt, ist ein mögliches weiteres Abbruchkriterium die Schrittweitenlänge, wenn diese kleiner wird als eine untere Grenze mit der Bedingung .

Verbesserungsschritte als Abbruchbedingung

[Bearbeiten]Ferner kann das Gradientenabstiegsverfahren abgebrochen werden, wenn die Verbesserung der Optimierung von in den Interationsschritten kleiner als eine untere Grenze wird.

Bedeutung von Abbruchkriterien

[Bearbeiten]Durch solche Abbruchkriterien wird algorithmisch gewährleistet, dass das Gradientenabstiegsverfahren nicht in einer Endlosschleife der Iterationen landet.

Aufgabe

[Bearbeiten]- Erläutern Sie, wie im Kontext von künstlichen neuronalen Netzen das Gradientenabstiegsverfahren für die Fehlerminimierung beim Maschinellen Lernen eingesetzt werden kann (Backpropagation)?

- Überprüfen Sie, ob und wie man mehrdimensionalen linearen Regression das Gradientenabstiegsverfahren einsetzen kann (siehe Gradient - lineares Funktional)!

Videos

[Bearbeiten]- Höhenlinien, Gradient, Vektorfeld, Vektoranalysis, ... Youtube-Video (21.07.2015) von Daniel Jung

- Gradient und Totales Differential Youtube-Video (21.07.2015) von Daniel Jung

Literatur

[Bearbeiten]- ↑ „Gradientenverfahren“. In: Wikipedia, Die freie Enzyklopädie. Bearbeitungsstand: 24. September 2016, 13:24 UTC. URL: https://de.wikipedia.org/w/index.php?title=Gradientenverfahren&oldid=158180650 (Abgerufen: 21. November 2017, 11:49 UTC)

- ↑ a b Gradientenabstieg mit Tabellenkalkulation, Jörg Rapp, Engelbert Niehaus (2018) GitHub Repository https://github.com/niebert/GradientDescent - ZIP: https://github.com/niebert/GradientDescent/archive/master.zip (letzter Zugriff 2019/04/28)

Siehe auch

[Bearbeiten]- Gradient

- Kurs:Numerik I

- Maschinelles Lernen

- Backpropagation als Anwendungsbeispiel

- mehrdimensionale lineare Regression

Seiteninformation

[Bearbeiten]Diese Lernresource können Sie als Wiki2Reveal-Foliensatz darstellen.

Wiki2Reveal

[Bearbeiten]Dieser Wiki2Reveal Foliensatz wurde für den Lerneinheit Numerik' erstellt der Link für die Wiki2Reveal-Folien wurde mit dem Wiki2Reveal-Linkgenerator erstellt.

- Die Seite wurde als Dokumententyp PanDocElectron-SLIDE erstellt.

- Link zur Quelle in Wikiversity: https://de.wikiversity.org/wiki/Gradientenabstiegsverfahren

- siehe auch weitere Informationen zu Wiki2Reveal und unter Wiki2Reveal-Linkgenerator.